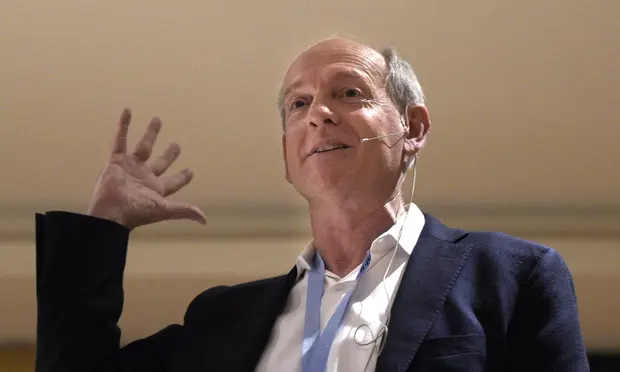

Stuart Russell, ex-conselheiro do governo, diz que o ChatGPT pode se tornar parte de uma máquina superinteligente que não pode ser restringida

Um dos professores na vanguarda da inteligência artificial disse que os ministros não estão fazendo o suficiente para proteger contra os perigos das máquinas superinteligentes no futuro.

Na mais recente contribuição ao debate sobre a segurança do desenvolvimento cada vez mais acelerado da IA, o professor Stuart Russell disse ao Times que o governo relutava em regulamentar o setor, apesar das preocupações de que a tecnologia pudesse sair do controle e ameaçar o futuro da humanidade.

Russell, professor da Universidade da Califórnia em Berkeley e ex-conselheiro dos governos dos EUA e do Reino Unido, disse ao Times que estava preocupado que o ChatGPT, lançado em novembro, pudesse se tornar parte de uma máquina superinteligente que não poderia ser restringida. .

“Como você mantém o poder sobre entidades mais poderosas do que você – para sempre?” ele perguntou. “Se você não tem uma resposta, então pare de fazer a pesquisa. É simples assim.

“As apostas não poderiam ser maiores: se não controlarmos nossa própria civilização, não podemos dizer se continuamos a existir.”

Após a divulgação do ChatGPT ao público no ano passado, que tem sido usado para escrever prosa e já tem preocupado palestrantes e professores com seu uso em universidades e escolas, o debate se intensificou sobre sua segurança a longo prazo.

Elon Musk, o fundador da Tesla e proprietário do Twitter, e o cofundador da Apple, Steve Wozniak, junto com 1.000 especialistas em IA, escreveram uma carta para alertar que havia uma “corrida fora de controle” acontecendo nos laboratórios de IA e pediu uma pausa na criação de IA em escala gigante.

A carta alertava que os laboratórios estavam desenvolvendo “mentes digitais cada vez mais poderosas que ninguém, nem mesmo seus criadores, podem entender, prever ou controlar de forma confiável”.

Há também preocupação com sua aplicação mais ampla. Um comitê da Câmara dos Lordes esta semana ouviu evidências de Sir Lawrence Freedman, um professor de estudos de guerra, que falou sobre as preocupações sobre como a IA pode ser usada em guerras futuras.

O rival do Google, Bard, deve ser lançado na UE ainda este ano.

O próprio Russell trabalhou anteriormente para a ONU sobre como monitorar o tratado de proibição de testes nucleares e foi convidado a trabalhar com Whitehall no início deste ano. Ele disse: “O Ministério das Relações Exteriores … conversou com muitas pessoas e elas concluíram que a perda de controle era um resultado plausível e de extrema importância”.

“E então o governo apresentou uma abordagem regulatória que diz: ‘Não há nada para ver aqui… daremos as boas-vindas à indústria de IA como se estivéssemos falando sobre fabricar carros ou algo assim’.

“Acho que cometemos um erro logo no início, quando estávamos tão fascinados pela noção de entender e criar inteligência que não pensamos sobre para que serviria essa inteligência”, disse ele.

“A menos que seu único objetivo seja beneficiar os humanos, você está na verdade criando um concorrente – e isso seria obviamente uma coisa estúpida de se fazer.

“Não queremos sistemas que imitem o comportamento humano… você basicamente o treina para ter objetivos semelhantes aos humanos e perseguir esses objetivos.

“Você pode imaginar como seria desastroso ter sistemas realmente capazes que buscassem esses tipos de objetivos.”